今天,我将分享一个名为 AstrBot 的开源项目,它是一个多平台聊天机器人开发框架,支持多种大语言模型的接入,并能够在 QQ、微信等多个消息平台上运行。AstrBot 是一款开源的多平台聊天机器人开发框架,支持多种大语言模型(如 OpenAI GPT、Google Gemini、Llama 等)和多个消息平台(如 QQ、Telegram、微信等)。它提供了多轮对话、语音转文字、网页搜索等功能,能够快速集成并部署在不同的环境中。

- 核心功能:支持 OpenAI GPT、Google Gemini、Llama 等大语言模型,以及 QQ、Telegram、微信等消息平台。

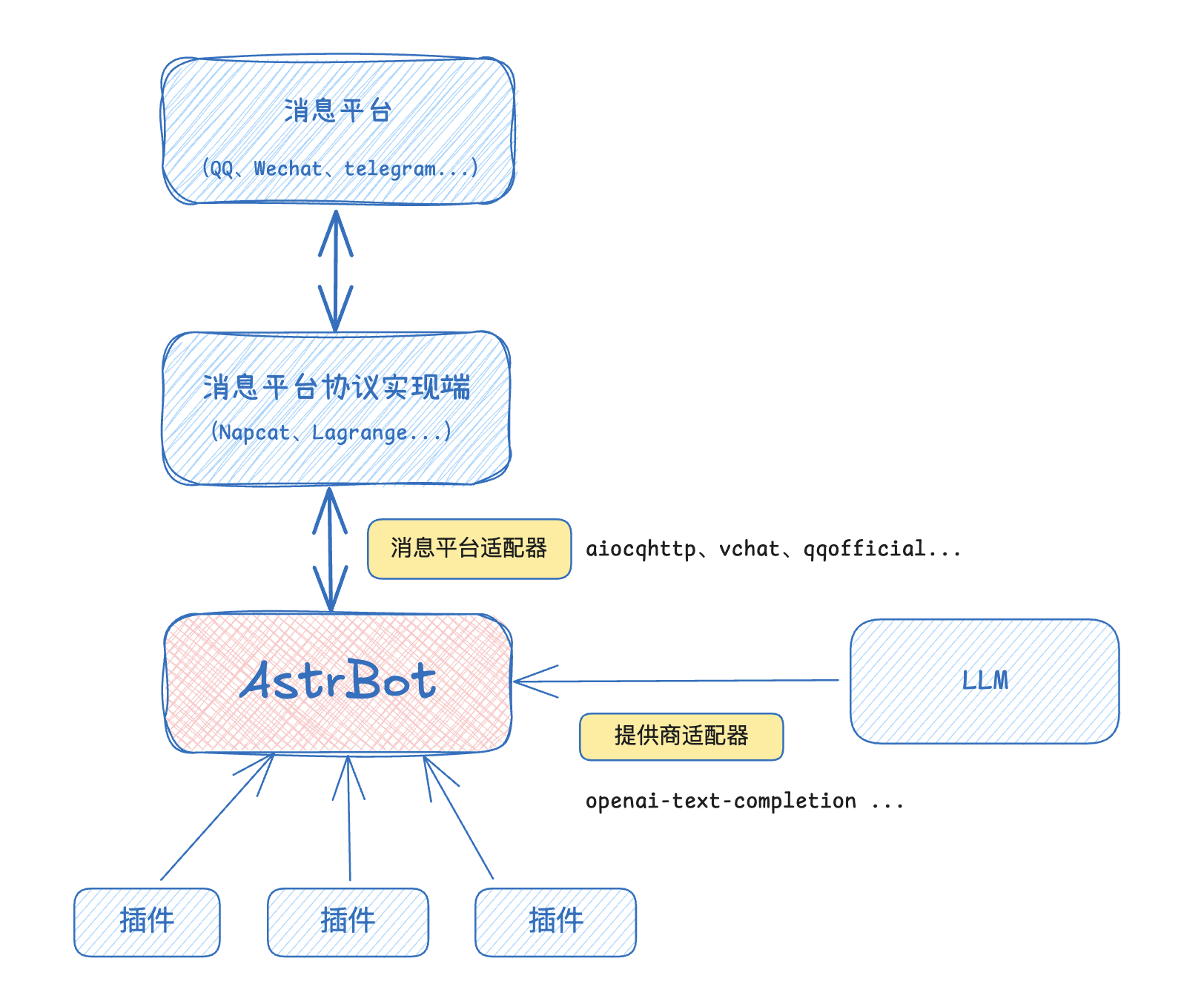

- 技术原理:采用异步通信架构、事件驱动机制和流水线处理,确保系统的高效稳定性。

AstrBot 是什么?

AstrBot 是一款开源的聊天机器人开发框架,支持多种大语言模型(如 OpenAI GPT、Google Gemini、Llama)和多平台消息接入(如 QQ、Telegram、微信)。它不仅支持多轮对话,还具备语音转文字、网页搜索等功能,且提供代码执行器和可视化管理面板,帮助开发者配置和扩展机器人。

AstrBot 的设计采用模块化结构,支持插件开发,能够轻松地部署到 Docker、Windows、Replit 等环境,确保高稳定性与可扩展性。

AstrBot 的主要功能

- 多语言模型支持:支持 OpenAI GPT、Google Gemini、Llama、DeepSeek、ChatGLM 等多种大语言模型,同时也支持基于 Ollama 和 LLMTuner 接入本地部署的大模型。

- 多平台接入:支持 QQ(OneBot)、QQ频道、微信(Gewechat、企业微信)、Telegram 等多个平台,未来将支持钉钉、飞书、Discord 等平台。

- Agent 功能:原生支持代码执行器、自然语言待办事项、网页搜索等功能,可与 Dify 平台进行智能助手和知识库接入。

- 插件扩展:提供深度优化的插件机制,支持开发者基于插件扩展功能,降低开发门槛。

- 可视化管理:提供可视化面板,支持配置修改、插件管理、日志查看等功能,集成 WebChat,使得开发者可以直接在面板上与机器人进行对话。

- 多模态交互:支持图片理解和语音转文字(Whisper),并具备多轮对话和个性化情境功能。

AstrBot 的技术原理

- 异步通信架构:AstrBot 基于异步编程模型,能够高效地处理多个平台的消息交互,提高系统的响应速度和并发处理能力。

- 事件驱动机制:基于事件总线设计,将消息接收、处理和发送解耦,使各个模块独立运行,增加系统的灵活性和可扩展性。

- 流水线处理:消息处理采用流水线模式,将消息解析、预处理、模型调用和后处理等步骤按顺序执行,便于功能扩展和维护。

- 插件系统:基于插件机制,开发者可以轻松扩展机器人的功能。插件支持独立开发和部署,不会影响主程序的运行。

- 多语言模型接入:支持多种大语言模型接入,基于标准化接口与不同模型通信,灵活实现模型切换与扩展。

如何使用 Docker 部署 AstrBot

环境准备

在开始部署 AstrBot 之前,请确保您的环境已经安装了 Docker。如果尚未安装,可以参考 Docker 文档 进行安装。

如果您位于中国大陆,可能会遇到无法拉取 Docker 镜像的问题。建议使用国内镜像源,或者在 Docker 设置中配置代理。参考 国内可用 Docker 镜像源汇总。

- Docker 文档:https://docs.docker.com/get-docker/

- 国内可用 Docker 镜像源汇总:https://changshaseo.net/summary-of-currently-available-docker-image.html

通过 Docker Compose 部署

1. 克隆 AstrBot 仓库

首先,使用以下命令将 AstrBot 仓库克隆到本地:

git clone https://github.com/Soulter/AstrBot cd AstrBot2. 运行 Docker Compose

接下来,使用 docker compose 命令启动 AstrBot:

sudo docker compose up -d- 注意:在 Windows 系统上不需要使用

sudo。

3. 配置沙箱代码执行器(可选)

默认情况下,docker-compose.yml 文件没有映射宿主机的 docker.sock 文件,因此无法使用沙箱代码执行器。如果需要使用沙箱代码执行器,可以在 docker-compose.yml 文件中添加以下内容:

volumes: - /var/run/docker.sock:/var/run/docker.sock通过 Docker 部署

1. 创建目录并运行容器

如果您不想使用 Docker Compose,可以直接通过 Docker 命令部署 AstrBot。首先,创建一个目录用于存储数据:

mkdir astrbot然后,使用以下命令启动 AstrBot 容器:

sudo docker run -itd -p 6180-6200:6180-6200 -p 11451:11451 -v $PWD/data:/AstrBot/data --name astrbot soulter/astrbot:latest- 注意:在 Windows 系统上不需要使用

sudo。

2. 查看日志

通过以下命令查看 AstrBot 的日志输出:

sudo docker logs -f astrbot3. 配置沙箱代码执行器(可选)

如果需要使用沙箱代码执行器,可以参考 Docker Compose 部分的配置,修改 docker run 命令以映射 docker.sock。

总结

AstrBot 是一款功能强大的聊天机器人开发框架,支持大语言模型接入、多平台消息接入以及多种智能助手功能。无论您是要构建一个简易的聊天机器人,还是开发一个高度定制化的 AI 助手,AstrBot 都能为您提供高效的开发支持。通过 Docker 部署,您可以快速将 AstrBot 部署到本地或云端,轻松享受跨平台的聊天机器人服务。

如果您希望了解更多相关技术,或者对 AstrBot 有任何疑问,欢迎在评论区留言,或者直接查看官方文档。

FAQs

- 如何使用 AstrBot 接入多个消息平台?

- AstrBot 支持通过配置不同平台的 API,接入多个消息平台。详细的配置教程可以在项目文档中找到。

- AstrBot 是否支持自定义插件?

- 是的,AstrBot 提供了插件机制,您可以根据需求开发和部署自定义插件。

- 我可以使用 AstrBot 创建个性化的对话流程吗?

- 可以,AstrBot 支持多轮对话和个性化情境功能,能够根据用户输入调整对话策略。

- 如何部署 AstrBot 到云服务器?

- 您可以通过 Docker 或 Docker Compose 部署 AstrBot 到云服务器,支持多平台环境。

- AstrBot 是否支持语音识别?

- 是的,AstrBot 集成了 Whisper 语音识别功能,能够将语音转为文字,增强交互体验。

- AstrBot 可以和 OpenAI GPT-4 集成吗?

- 可以,AstrBot 支持与 OpenAI GPT、Google Gemini 等大语言模型的集成,您可以根据需求选择合适的模型。

结论

AstrBot 为开发者提供了一个高效、易于扩展的多平台聊天机器人开发框架。通过其强大的插件机制和多平台支持,开发者能够快速实现基于大语言模型的 AI 聊天机器人。如果你对 AI 聊天机器人开发有兴趣,不妨试试 AstrBot,轻松将大模型接入 QQ、微信等多个平台,打造自己的多功能聊天助手!